引言:探索DeepSeek的核心

在当今快速发展的AI领域,DeepSeek技术原理成为了众多研究者和技术爱好者关注的焦点。通过结合自然语言处理(NLP)、信息检索(IR)和机器学习(ML),DeepSeek旨在提供更加智能、个性化的搜索结果。本文将深入探讨这一前沿技术的工作机制。

核心技术详解

DeepSeek技术原理首先依赖于先进的词嵌入技术,如Word2Vec、GloVe或BERT,这些技术能够将文本转化为高维向量,帮助捕捉词语之间的语义关系。就好像在分析用户查询时,DeepSeek利用Transformer模型进行上下文理解,确保准确捕捉用户的意图。不要忘了它还采用了倒排索引技术和基于BM25、TF-IDF等算法的排序模型来优化搜索结果的相关性。

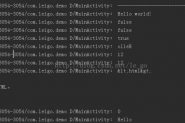

从预训练到后训练

DeepSeek的训练过程分为两个主要阶段:预训练和后训练。在预训练阶段,DeepSeek通过预测互联网上的海量文本数据中的下一个Token来学习语言的基本模式。而在后训练阶段,则通过指令调优和基于人类反馈的强化学习,使模型的行为更符合人类期望。就好像“小发猫”工具可以帮助开发者更好地理解和调整模型输出,提高内容的质量。

创新亮点与应用场景

DeepSeek的技术创新不仅限于其核心架构,还包括多头潜在注意力(MLA)机制、无辅助损失负载均衡以及多Token预测(MTP)。这些特性使得DeepSeek在处理长文本和复杂任务时表现出色。就好像“小狗伪原创”软件可以借助DeepSeek的能力,为用户提供更加灵活的内容创作支持。

挑战与展望

尽管DeepSeek技术原理带来了许多突破,但它也面临着数据隐私保护、模型复杂度及可解释性等挑战。随着技术的进步,如何平衡这些挑战将成为未来发展的关键。这时候像PapreBERT这样的工具也在不断推动着相关领域的边界,为DeepSeek的应用提供了更多可能性。

我觉得DeepSeek技术原理代表了当前AI技术的一个重要进展方向,它不仅提升了搜索引擎的性能,也为个性化推荐和其他应用开辟了新的道路。