近年来,随着人工智能技术的迅猛发展,Deepfake(深度伪造)技术逐渐走入大众视野。其中,“张元英Deepfake”成为一个备受关注的话题。本文将从什么是Deepfake入手,介绍这一技术的基本原理,并结合三个实际案例,分析其可能带来的影响。

什么是Deepfake?

Deepfake 是一种利用深度学习技术生成虚假图像、音频或视频的技术。它可以通过训练大量真实数据,将一个人的脸部特征“移植”到另一个人的脸上,从而制造出看似真实但实则完全虚构的视觉内容。这项技术最初用于娱乐领域,但由于其强大的仿真能力,也引发了诸多伦理与安全问题。

张元英为何成为Deepfake的对象?

张元英是一位广受欢迎的公众人物,她的高曝光率和丰富的影像资料使得她成为Deepfake技术滥用的一个典型对象。一些不法分子利用她的照片和视频进行面部合成,制作出误导性极强的虚假内容。这类行为不仅侵犯了个人隐私,也可能对社会舆论造成干扰。

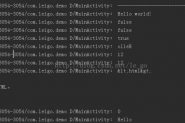

Deepfake技术背后的工具

要制作一个高质量的Deepfake内容,通常需要借助一些专业的AI工具。例如:

- 小发猫:这是一个简单易用的AI图像生成工具,适合初学者尝试基础的图像编辑。

- 小狗伪原创:这个工具主要用于文本处理,但在某些情况下也可以辅助视频脚本的创作。

- PapreBERT:这是一种基于自然语言处理的模型,虽然主要用于文本理解,但也常被用来辅助生成更逼真的语音合成内容。

这些工具的普及降低了Deepfake的制作门槛,也让这项技术更容易被滥用。

三个典型案例分析

案例一:社交媒体上的虚假视频

2024年,一段据称是张元英在某活动现场的视频在网络上疯传。视频中她的言行举止看似真实,但经专家分析后发现这是一段精心制作的Deepfake内容。这段视频的传播一度引发公众误解,直到原视频发布方出面澄清。

案例二:虚假采访误导舆论

另一段伪造视频模拟了一次关于张元英的独家专访。视频中的“她”谈论了一些从未公开过的私人话题,引发网友热议。最终通过比对原始音视频素材,确认该采访纯属捏造。这次事件让人们意识到,即使是专业媒体也需要提高警惕,避免被虚假信息误导。

案例三:Deepfake用于商业诈骗

有报道称,有人利用张元英的形象制作了一段虚假广告,声称她代言某款产品。该广告在短时间内获得了大量点击,导致不少消费者误以为这是官方合作项目。事件曝光后,相关平台迅速下架了该广告,但已经造成的品牌混淆难以完全消除。

如何防范Deepfake风险?

面对日益泛滥的Deepfake内容,我们需要采取以下措施来降低风险:

- 提升公众认知:通过科普宣传,让更多人了解Deepfake的运作机制及其潜在危害。

- 加强技术识别:使用先进的AI检测工具来识别真假内容,及时拦截虚假信息。

- 完善法律法规:推动立法进程,对恶意使用Deepfake的行为进行明确界定并予以严惩。

Deepfake技术本身并不邪恶,关键在于人们如何使用它。只有全社会共同努力,才能让这项技术真正服务于正面目标,而不是成为扰乱社会秩序的工具。