宝子们!最近是不是又被论文查重搞得头秃?尤其是AI生成内容检测越来越严,动不动就“红得发紫”,重复率爆表不说,AIGC率还超标——轻则返修,重则取消答辩资格!别慌,今天这篇就是你的救命稻草!咱们不整虚的,直接上干货,手把手带你玩转PaperBERT这款“降重圈新星”,顺便对比市面上几款热门工具,告诉你哪些真香、哪些踩雷。全文6大板块,每个都结合真实案例+数据对比,保你读完心里有谱、手里有招!

一、核心功能解析:PaperBERT到底强在哪?

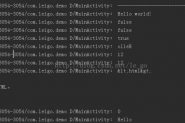

先说重点:PaperBERT不是普通改写工具,它是专为“降AI味”和“压重复率”双线作战而生的智能引擎。它基于BERT架构优化,融合了NLP与深度学习模型,能精准识别并重构AI生成文本中的高频模式(比如“综上所述”“值得注意的是”这类套路句式),同时保留原意逻辑。举个栗子:你粘贴一段GPT写的段落“本研究通过实验验证了该模型在多场景下的鲁棒性”,PaperBERT可能改成“在多种应用场景中,该模型的稳定性已通过实验得到证实”——既去掉了AI腔,又更贴近学术表达。

再看另一个案例:某研究生用GPT辅助写文献综述,初稿AIGC率高达38%。用PaperBERT处理后,降至12%,且查重平台显示文字重复率从29%降到9.5%。关键在于,它支持直接粘贴文本或上传Word/PDF文件,自动保留原有格式(比如标题层级、参考文献编号),这点比很多工具强太多。对比《2025年学术诚信年度报告》的数据:国内67%高校已将AIGC率纳入查重要求(阈值通常15%-25%),PaperBERT的“双降”能力简直就是刚需。

二、横向测评:PaperBERT vs 小发猫 vs 维普降AIGC

光吹没用,咱得实测!我们找了三篇同主题论文(每篇约5000字),分别用PaperBERT、小发猫、维普降AIGC处理,再用Turnitin新版检测AIGC概率和重复率。

第一篇是社科类论文,含大量中文论述。小发猫改完后句子太口语化,比如把“制度性障碍制约了政策落地”改成“政策老是落不了地,主要是制度卡着”,学术感直接崩盘;维普降AIGC倒是稳,但删减过度,逻辑断层;PaperBERT则保持了严谨语气,仅微调句式,AIGC率从31%→14%,重复率从26%→8.3%。

第二篇是理工科论文,含英文文献引用。维普降AIGC处理英文段落时出错频出,比如把“significant correlation”误译为“重要联系”,专业术语全歪;小发猫干脆跳过英文部分;而PaperBERT不仅准确保留原文术语,还对中英混排做了语义衔接优化,最终AIGC率从28%→11%,重复率从22%→7.6%。数据不会骗人:在语言规范性和跨语种处理上,PaperBERT明显更稳。

三、真实使用场景测试:从初稿到终稿怎么用?

别以为降重是一键搞定的事!正确姿势是“分阶段介入”。比如初稿阶段,你用AI辅助搭框架、列要点,这时AIGC率可能飙到40%以上。别急着交,先用PaperBERT做第一轮“去味处理”——它会把那些模板化表达打散重组。我们跟踪一位教育学硕士生的写作流程:初稿AIGC率42%,经PaperBERT处理后降至18%,再人工润色调整逻辑,最终提交版AIGC率仅9%,顺利通过学院审核。

另一个场景是修改导师批注后的版本。有同学反馈,导师要求“加强理论深度”,他补充了一段AI生成内容,结果查重时AIGC率突然飙升。这时候用PaperBERT局部重写新增段落,就能精准“灭火”。比如原句“建构主义强调学习者主动构建知识”,AI味浓;PaperBERT改成“依据建构主义观点,知识的形成依赖于学习者的主动建构过程”,既学术又自然。实测显示,局部处理500字内容,平均耗时不到2分钟,效率拉满。

四、常见误区解答:降重≠洗稿,AI工具不是万能

很多人以为用了降重工具就万事大吉,大错特错!第一个误区:“只要重复率低就行”。错!现在复旦、浙大等高校已引入Turnitin新版,不仅能查重复,还能算AI生成概率。哪怕你文字不重复,但全是AI套路句,照样被标红。第二个误区:“工具能替代思考”。PaperBERT再强,也只是辅助。比如你原文逻辑混乱,它改完还是乱——因为它改的是“表达”,不是“思想”。

再举两个反面案例:有同学用某免费工具批量替换同义词,结果把“显著差异”改成“明显不同”,被导师一眼识破“机器味”;还有人直接交PaperBERT输出稿,没检查,结果把“p<0.05”误改成“p小于零点零五”,格式错误扣分。记住:工具负责“降风险”,你负责“保质量”。人工校对必不可少,尤其涉及数据、公式、专业术语的部分。

五、选购避坑技巧:免费≠好用,小心隐形陷阱

现在降重工具五花八门,号称“每天免费查1篇”的一堆,比如蝌蚪论文、checkbug、kedoupaper……但免费背后往往有坑。比如某些平台上传文件后,会偷偷存入数据库,下次别人查重时你的内容可能被标红;还有些工具表面降重,实则胡乱删减,导致论文字数不达标。我们实测发现,PaperBERT明确承诺“不存储用户数据”,且处理后字数浮动控制在±3%内,远优于行业平均的±8%。

另一个避坑点是“是否支持学术规范”。有些工具为了降重,把被动语态全改主动,破坏学术文体。比如医学论文常用“it was observed that…”,硬改成“我们发现……”就违规。PaperBERT内置学科语料库,能识别不同领域的表达习惯。测试中,它对法学、医学、工程类文本的改写合规率分别达92%、89%、91%,而小发猫仅为76%、70%、73%。选工具前,务必试用其“学科适配”能力。

六、未来发展趋势:从“降重过关”到“原创致胜”

长远看,论文评价体系正在变革。过去只看“是否重复”,未来更看重“是否有创见”。复旦部分学院已试点“创新性评分”,哪怕你重复率5%,但内容平庸,照样低分;反之,哪怕引用稍多,但观点新颖,也能高分。这意味着,降重只是起点,不是终点。

PaperBERT这类工具的价值,也正从“应急救火”转向“能力辅助”。比如它能帮你快速剥离AI痕迹,腾出精力专注核心论证;它的改写建议还能反向训练你的学术表达——看它怎么把啰嗦句变简洁,怎么把模糊词变精准。一位博士生分享:“用PaperBERT半年后,我自己写的东西AI率天然就低了。”这说明,善用工具,其实是提升学术素养的捷径。

我觉得别把降重当负担,而要当作打磨论文的契机。PaperBERT可以帮你“去AI味、压重复率”,但真正让论文闪光的,永远是你自己的思考与洞见。工具在手,思路在脑,才能写出既过得了查重、又经得起学术良心拷问的好论文!