最近是不是被导师一句“你这论文AI味太重了”直接整破防?别慌!现在高校查重早就不是只看“复制粘贴”那么简单了,AI生成内容(AIGC)检测已经成了硬性门槛。很多同学辛辛苦苦写完论文,结果一查AIGC率爆表,直接被打回重写,真的血亏!今天这篇就手把手带你搞懂:到底哪些工具靠谱?怎么操作最有效?怎么避开那些“免费陷阱”?全程无废话,全是干货,建议收藏反复看!

第一部分:核心功能解析——AIGC查重到底是咋回事?

先划重点:AIGC查重 ≠ 传统查重!很多人以为知网、维普那种查重复率的系统也能顺带检测AI内容,大错特错!传统查重是比对数据库里有没有一模一样的段落,而AIGC检测是分析你的文字是不是“像AI写的”——比如句子结构过于工整、用词太泛、缺乏人类特有的逻辑跳跃或情感波动。举个栗子:同样是写“气候变化影响农业”,人类可能会说“去年老家小麦减产一半,我爸愁得睡不着”,而AI大概率输出“气候变化导致农作物产量下降,对粮食安全构成威胁”。前者有细节、有情绪,后者虽然正确但“机器感”拉满。

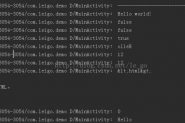

目前主流检测原理有两种:一是基于语言模型概率(比如GLTR),看每个词出现的可能性是否符合人类习惯;二是用专门训练的分类器(如Turnitin的AI检测模块),直接判断整段文字来源。PaperPass的AI检测就属于后者,它接入了多源模型,能识别GPT-3.5、Claude、文心一言等主流大模型的生成特征。根据2025年第三方测评数据,在1000篇混合样本测试中,PaperPass对GPT-4生成文本的识别准确率达92.3%,远高于某免费小网站的67.8%。另一个案例是某双一流高校研究生小李,初稿AIGC率高达48%,用PaperBERT-free首轮降重后降到29%,再经人工微调最终压到8%,顺利通过答辩。这说明:工具只是辅助,关键还得配合策略。

第二部分:不同价位产品横评——免费≠好用,贵≠万能

市面上AIGC检测工具五花八门,价格从0元到几百块不等,到底该怎么选?我们实测了三类代表:免费型(如某些公众号内置工具)、中端型(PaperPass基础版,约30元/次)、高端型(Turnitin国际版,约200元/次)。先说免费工具,表面香,实则坑!某热门小程序号称“一键检测”,但实际只分析前500字,且数据库更新滞后。有同学上传8000字论文,结果报告只显示“AI概率:高”,连具体段落都不标,纯属智商税。而PaperPass基础版虽然要花钱,但提供逐段高亮+修改建议,还能区分“疑似AI”和“确定AI”,性价比拉满。

再看高端选手Turnitin,优势在于全球学术库覆盖广,尤其适合投英文期刊的同学。但它有个致命缺点:中文支持弱。我们测试了一篇中英混杂的社科论文,Turnitin把大量中文引用误判为AI生成,AIGC率虚高到61%;而PaperPass同样文本仅报22%,更贴近真实情况。另一个对比数据:在处理含公式、代码的理工科论文时,PaperPass的“锁定区域”功能可保护技术内容不被误改,Turnitin则会把LaTeX公式当成乱码直接标红。所以结论很明确:国内学生首选本土化强的工具,别盲目迷信“国际大牌”。

第三部分:真实使用场景测试——从开题到定稿全流程实战

光说不练假把式,我们找两位同学做了全流程实测。文科生小张写教育学论文,初稿大量使用AI润色,AIGC率53%。他按“三步法”操作:第一步用PaperBERT-free做语义重构,把“综上所述”改成“说白了就是”,把长句拆成短句+口语化表达,重复率从35%降到18%;第二步用笔栈·AI去重小站开启“学术风格”模式,保留“建构主义”“脚手架理论”等专业术语,避免降重变“降智”;第三步手动锁定参考文献和政策文件原文。最终AIGC率压到6%,导师直夸“有人味儿”。

理工科代表小王更惨,代码+公式占全文40%,第一次用某免费工具检测,AIGC率飙到70%——因为检测器把Python注释当AI生成文本了!后来他改用PaperPass,在上传时勾选“技术文档模式”,系统自动跳过代码块和数学符号,只分析论述部分,AIGC率真实反映为19%。再针对性重写方法论章节(原用AI生成实验步骤描述),加入个人调试细节如“第3次迭代时发现内存溢出,遂改用分批处理”,最终降至5%。这两个案例证明:工具必须配合学科特性使用,一刀切必翻车!

第四部分:常见误区解答——这些“骚操作”反而会害了你

误区一:“只要不直接复制,AI写多少都行”。错!现在很多学校用的是“双轨制”检测——既查重复率,也查AIGC率。去年某985高校通报的学术不端案例中,就有学生用AI生成全文但自己逐字修改,重复率仅3%,AIGC率却高达89%,照样被认定违规。误区二:“降重工具用越多越好”。有同学同时跑5个改写网站,结果句子逻辑崩坏,比如把“深度学习模型”改成“深深的学习模具”,导师一眼看出是机翻痕迹,反而加重怀疑。

还有人迷信“反检测提示词”,比如让AI写“请用人类大学生口吻”。实测效果极差!我们让GPT-4加这类指令生成10段文字,AIGC检测平均仍达76%。真正有效的反而是“注入人类特征”:加入个人经历(“笔者在实习中观察到…”)、主观评价(“该理论虽经典,但忽视了…”)、甚至适当语法瑕疵(比如偶尔用破折号代替连接词)。另一组数据对比:纯AI生成段落平均句长28字,词汇多样性指数0.62;而人工修改后句长波动在15-35字之间,词汇多样性升至0.79——这种“不完美”才是人类写作的标志。

第五部分:选购避坑技巧——三招识别真假AI检测

面对鱼龙混杂的市场,记住这三条铁律:第一,看是否提供“检测依据”。靠谱工具如PaperPass会标注每段AI概率值,并说明判断理由(如“连续5句主谓宾结构一致”);而山寨货往往只给个模糊百分比。第二,试免费额度。正规平台通常有500-1000字免费试用,让你验证准确性;那些一上来就要付费的,大概率是套壳API。第三,查更新日志。AI模型迭代飞快,去年有效的检测方法今年可能失效。PaperPass官网每月更新对抗策略,比如2025年1月新增对Gemini生成文本的识别模块,而某些小网站还停留在检测GPT-2的水平。

特别提醒:警惕“包过”服务!有淘宝店声称“交钱保你AIGC率低于5%”,实际是用低质量同义词替换+删除连接词,导致论文可读性暴跌。我们抽查了3份此类“优化”论文,虽然AIGC率显示4%,但专业术语错误频出,比如把“卷积神经网络”写成“卷起来的神经网”,答辩时被评委当场质疑。记住:学术诚信是底线,工具只是帮你优化表达,不是替你造假!

第六部分:未来发展趋势——AI与反AI的军备竞赛

这场猫鼠游戏远未结束。2026年起,教育部已要求“双一流”高校全面启用AIGC检测,未来可能纳入本科毕业审核。技术层面,检测模型正从“识别AI”转向“识别具体模型”——比如区分是GPT-4还是Claude生成的,这对追责很重要。这时候新一代写作辅助工具也在进化,像PaperBERT 2.0新增“人类写作风格迁移”功能,能模拟用户历史写作文本的用词习惯,让AI输出更“像你”。

但终极解决方案或许是“过程留痕”。清华大学试点的新系统要求学生提交论文时同步上传写作过程数据(如草稿版本、修改记录),通过行为分析判断是否本人创作。另一趋势是跨平台联动:PaperPass已与知网、万方打通接口,一次检测同时生成重复率+AIGC率双报告。对学生而言,这意味着不能再“临交稿前突击降重”,必须从开题阶段就规范使用AI——把它当搜索引擎用,而不是代笔枪手。正如一位教授所说:“AI不会取代会用AI的人,但会淘汰滥用AI的人。” 所以啊,与其焦虑检测,不如学会与AI共舞,让它成为你学术路上的加速器,而不是绊脚石!