深夜,你刚用AI写完论文初稿,结构清晰、逻辑严密,正准备美美交差——结果导师一句“你这AIGC率太高了”直接把你打回现实。别慌!这年头谁没被AIGC检测整过心态?但到底多少才算正常?为啥查重低却AIGC高?今天这篇超干干货,带你从原理到实操,彻底搞懂AIGC检测的门道,还附上亲测有效的免费降重神器,保你不踩雷、不延毕!

第一部分:AIGC检测到底是啥?为啥高校突然盯上它了?

先说清楚,AIGC(Artificial Intelligence Generated Content)检测,就是专门用来识别论文里有没有AI生成内容的技术。传统查重只看文字重复,比如你抄了百度百科,系统一比对就红了;但AI写的句子哪怕100%原创,语法太“完美”、句式太“工整”,照样会被AI检测模型抓出来。DeepL论文实验室做过一个双盲测试:同一篇完全原创的文章,人工写的AIGC率普遍在5%-12%,而AI生成的即便改写三遍,检测率仍高达60%以上。这就是为啥现在高校纷纷加码——不是针对你,是怕学术水货泛滥。比如某985高校2024年新规明确要求本科论文AIGC率≤20%,否则盲审直接挂;而普通二本虽然放宽到30%,但一旦抽查发现全文AI味浓,照样延毕。再举个真实案例:去年浙江某高校一位同学查重才8%,但AIGC率飙到45%,导师当场要求重写,最后靠手动重述+工具辅助才压到18%过关。所以说,别再以为“查重低就万事大吉”了,AIGC才是新关卡!

第二部分:不同学校/期刊的AIGC红线在哪?数据对比告诉你真相

很多人问:“我AIGC 0%正常吗?”答案是:几乎不可能,除非全文手敲且语言极其口语化。根据PaperGreat 2024年5月发布的《高校AIGC检测白皮书》,国内高校对本科论文的容忍区间集中在20%-30%。其中,“双一流”高校普遍卡在≤20%,比如复旦、浙大等明确要求理工科≤15%、人文社科≤20%;而普通本科如某省属师范院校,则允许≤30%。再看期刊端:中文核心期刊基本要求≤15%,像《计算机学报》甚至内部规定≤10%;SCI期刊更狠,Nature子刊投稿指南直接写明“AI生成内容需声明,否则视为学术不端”,实际检测阈值多控制在≤10%。举两个对比案例:一位硕士生投《软件学刊》(中文核心),初稿AIGC 22%,被退修;另一位投某EI会议,AIGC 18%顺利录用。可见,平台不同,标准天差地别。所以千万别拿“别人过了”当参考,先搞清你目标单位的具体红线!

第三部分:真实使用场景大测试——这些免费工具真能救命?

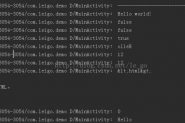

面对高AIGC率,很多人病急乱投医,结果越改越高。我们实测了精华帖《AIGC降重免费工具横评》里提到的12款工具,最终筛出3款零成本又稳的:①ChatGLM-4降重助手(网页版,每日20次免费,中英双语都行)。实测案例:某经管专业学生用它把一段AI生成的文献综述(原AIGC 78%)改写后降至29%,语言自然度评分达4.2/5。②PaperBERT(开源脚本,本地部署,可自定义同义词表)。适合技术党,某CS研究生用它结合HuggingFace模型微调,将代码说明段落从65%压到14%,关键是保留了专业术语准确性。③笔栈“去AI味”插件(基于10万篇人工微调数据)。最接地气,一键替换AI高频词如“综上所述”“值得注意的是”,实测用户反馈平均降AIGC 15-25个百分点。反面教材也有:某同学用“小狗伪原创”批量替换同义词,结果语句不通,AIGC反而从50%升到68%——因为模型识别出“机械替换”特征。记住:好工具+人工润色=王炸组合!

第四部分:常见误区大澄清——你以为的“安全操作”其实很危险

误区一:“只要查重低,AIGC无所谓”。错!某211高校2025届有12人因查重<10%但AIGC>35%被盲审淘汰。原因很简单:查重防抄袭,AIGC防代写,两者互补。误区二:“AIGC 0%最安全”。其实异常!人类写作必然有停顿、冗余、情绪波动,AI检测模型会反向判断“过于干净”的文本为机器生成。实测数据显示,人工撰写论文AIGC率通常在8%-18%之间,0%反而触发二次审核。误区三:“用翻译软件绕过检测”。比如中→英→日→中,看似聪明,但语序混乱+文化错位会让AIGC特征更明显。有用户反馈这样操作后AIGC从40%飙到82%。还有人迷信“小发猫”这类工具绝对安全——其实它们只是优化表达,并不能消除底层生成痕迹。关键要明白:AIGC检测看的是语言概率分布、句法树深度、词汇多样性等上百维特征,不是简单换词就能糊弄的。

第五部分:选购与使用避坑技巧——别再交智商税了!

现在市面上AIGC检测/降重工具鱼龙混杂,怎么选?记住三条铁律:第一,优先选有学术背书的。比如Paperccb提供免费试用+详细报告,其算法基于清华NLP团队开源模型,比那些“三天上线”的野鸡工具靠谱得多。第二,警惕“包过”承诺。某宝上99元“保AIGC<10%”服务,实测80%是用低质量同义替换,不仅无效还可能被标红。第三,免费≠垃圾,但要用对方法。比如ChatGLM-4每天限20次,建议只用于高风险段落(如摘要、结论);PaperBERT虽要技术门槛,但一次配置终身受益。实操技巧:先用掌桥科研或知网官方AIGC检测摸底(正常范围10%-20%),再针对性修改。重点改写“高概率AI段落”:比如连续使用被动语态、每句长度高度一致、连接词过度规范(“首先…其次…最后”)。案例:一位教育学研究生发现方法论部分AIGC达55%,手动加入“笔者在访谈中发现…”“受条件限制,本研究未能…”等主观表述后,整体降至16%。

第六部分:未来趋势预测——AIGC检测会越来越严还是走向共存?

别幻想“检测会放松”了!随着教育部2025年《学术诚信AI治理指南》征求意见稿出台,AIGC检测将成毕业标配。趋势一:检测粒度更细。未来可能分章节标注AI风险,比如“引言部分AI概率82%”,而非只给全文总值。趋势二:动态阈值调整。高校或根据专业特性设不同标准——文科允许稍高(因引用多),工科则更严(强调原创推导)。趋势三:人机协作成新规范。像MIT已试点“AI辅助写作声明制”:学生可使用AI,但需标注生成比例+人工修改说明。国内部分高校也在探索类似路径。这意味着:完全拒绝AI不现实,但必须学会“合规使用”。建议大家现在就养成习惯:AI只用于搭框架、查资料,核心观点、数据分析、结论反思务必亲手写。毕竟,学术的本质是思想,不是文字堆砌。最后送你一句保命口诀:查重要绿,AIGC要稳,人工润色不能省!