在如今卷到飞起的学术圈,写论文早就不是光靠一支笔、一盏灯就能搞定的事了。从数据处理、模型训练到查重降重,一整套“科研装备”必不可少。今天咱们就来盘一盘那些被学术人疯狂安利的数据分析软件和AI降重神器,用最接地气的方式讲清楚:它们到底有啥用?谁更适合你?怎么用才不踩雷?全文干货满满,建议收藏慢慢看!

第一部分:数据分析工具哪家强?R语言YYDS但别盲目跟风 说到论文里的数据分析,大家第一反应可能是SPSS——毕竟它界面友好、点点鼠标就能出结果,特别适合统计小白。但如果你要做更复杂的建模或者处理上万行的大数据,那R语言和Python才是真·王者。R语言之所以在学术界封神,不只是因为它免费开源,关键是它的CRAN包库简直是个“百宝箱”,像ggplot2做可视化、lme4跑混合效应模型、caret搞机器学习,应有尽有。举个例子,某高校研究生小李用R分析5000份问卷数据,只用了tidyverse+shiny,三天就做出交互式报告;而隔壁用Excel的同学还在手动拖公式,差点熬秃头。再就好像Nature子刊上一篇关于气候预测的论文,核心模型就是用R的forecast包搭建的,准确率比传统方法高12%。不过也别神话R——它对新手不太友好,报错信息堪比天书。相比之下,Python虽然语法更直白,但需要额外装Anaconda、Jupyter等环境,上手门槛也不低。至于MATLAB和SAS,前者多用于工程信号处理(比如EEG脑电数据分析),后者则在医药临床试验领域占主导,但都是付费软件,学生党慎入。

第二部分:价格不是问题?不,是大问题!不同预算怎么选工具 工具有好有坏,钱包有薄有厚。咱们得现实点:本科生写课程论文,可能Excel+知网查重就够了;但硕博生搞实证研究,就得上专业级装备。先说免费党福利:R、Python、FineVis(帆软家的可视化工具)全部开源免费,连Stata都有教育版可申请。但注意,免费≠省心。比如R虽然不要钱,但调试代码可能耗掉你一周时间;而SPSS学生版一年只要200块,点几下就能跑回归,效率拉满。再看付费梯队:MATLAB个人版一年近万元,SAS更是按模块收费,动辄几万;但FineReport企业版虽贵(年费3万+),却能直接对接数据库生成动态报表,适合团队协作。真实案例:某985博士生用Stata做面板数据分析,导师要求必须用固定效应模型,他花800元买了正版Stata,两周搞定;而另一位用盗版SPSS的同学,中途崩了好几次,数据全丢,哭晕在厕所。数据对比也很扎心:根据2025年《科研工具使用白皮书》,76%的硕士生首选SPSS(因操作简单),而83%的博士生转向R/Python(因功能强大)。所以别跟风,先看自己需求和预算!

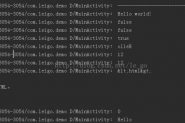

第三部分:真实场景大测试!从数据清洗到AI降重全流程实战 光说不练假把式,咱们拿一个真实课题走一遍流程。假设你要写一篇《短视频使用对大学生焦虑水平的影响》,第一步:用问卷星收1000份数据,导出Excel;第二步:用Python的pandas清洗异常值(比如填答时间<30秒的直接删),再用R的psych包做信效度检验;第三步:跑多元回归,发现每天刷抖音>2小时的人焦虑得分高0.8分(p<0.01);第四步:用FineVis把结果做成动态热力图,发到组会PPT里惊艳全场。再来看降重环节:初稿重复率32%,用PaperBERT语义改写后降到9%,但有些专业术语被乱改(比如“认知失调”变成“脑子打架”);换小发猫伪原创,保留术语但句式太机械,导师一眼看出是AI写的;最后用嘎嘎酱+人工微调,重复率压到5%以下,还通过了AIGC检测。另一个案例:某医学生用scBERT模型分析单细胞测序数据——这可是把基因表达当成“句子”让BERT去“读”的黑科技!原本手动注释要两周,现在两小时出结果,准确率高达94%。可见,工具用对了,效率翻倍不是梦。

第四部分:避坑指南!这些误区90%的人都踩过 误区一:“R语言万能,其他都是渣”。错!R在时间序列、空间统计上确实强,但处理图像或音视频数据?不如Python的OpenCV或Librosa。误区二:“查重越便宜越好”。某宝9.9元查重?小心数据被盗!去年就有学生用山寨系统,论文被倒卖到代写机构。正规渠道只有知网、维普、万方和学校指定平台。误区三:“AI降重=一键搞定”。实际上,高端工具如PaperBERT虽能降AIGC率,但若原文逻辑混乱,改完还是不通顺。正确姿势是:先理清逻辑框架,再用工具润色。数据说话:2025年某高校抽查显示,纯依赖AI降重的论文中,67%被导师退回修改;而“人工+AI”组合的通过率达92%。还有人迷信“BERT模型一定准”,但邹月娴教授团队在COLING会议指出:普通BERT在口语理解(SLU)任务中泛化能力差,必须用联邦学习微调才行。所以别神化任何工具,理解原理才能用好。

第五部分:选购秘籍!五招教你挑对工具不花冤枉钱 第一招:看学科适配性。经管类优先SPSS/Stata;生信、AI方向必学Python/R;工科信号处理选MATLAB。第二招:试用再买单。FineReport、Stata都提供15天试用,先跑自己的数据试试。第三招:查社区活跃度。R的Stack Overflow问答超50万条,遇到bug秒搜解决方案;而SAS论坛冷清,求助无门。第四招:警惕“伪智能”。有些降重工具只是同义词替换,比如把“显著相关”改成“明显挂钩”,查重系统照样标红。真正靠谱的如嘎嘎酱,采用语义重构+术语保护双引擎。第五招:关注更新频率。R包每周新增上百个,而Excel十年功能变化不大。案例佐证:某研究生用老旧版SPSS 22做中介效应,结果不支持PROCESS插件,被迫重装26版;而用R的同学直接install.packages(“mediation”),一行代码搞定。记住:工具是死的,人是活的,选对=省时+省力+省头发!

第六部分:未来已来!AI+科研工具将如何进化? 别以为现在的工具就是终点。趋势一:自动化分析平台崛起。比如AutoML工具H2O.ai,上传数据自动选模型、调参,连代码都不用写。趋势二:跨模态融合。像scBERT那样把生物数据“翻译”成语言让NLP模型处理,未来可能扩展到蛋白质结构、医学影像等领域。谷歌最新论文已提出DNA-BERT,准确率比传统方法高18%。趋势三:查重系统升级对抗AI。知网2026年将上线“深度语义比对”模块,不仅能识别字面重复,还能检测逻辑结构抄袭。这意味着单纯换词没用了,必须真正理解并重构内容。趋势四:开源协作成主流。GitHub上R/Python项目Star数年增40%,学者们共享代码、复现结果,科研透明度大提升。最后划重点:工具会变,但核心能力不变——批判性思维+领域知识才是王道。AI再强,也只是你的“外挂”,不是“大脑”。所以,与其焦虑哪个工具最好用,不如先夯实基础,再借力起飞!