说到写论文,尤其是工科生,那真是又肝又秃!但最头疼的不是数据跑不出来,而是辛辛苦苦写的稿子一过格子达、知网这些AI检测系统,AIGC率直接爆表——80%、90%,甚至100%!别慌,今天就手把手教你用“小发猫”这类靠谱工具,配合人工精修,把AI痕迹压到个位数,顺利毕业不踩雷。先划重点:AI不是不能用,关键得会“混搭”——工具初筛+人工润色=稳过!

第一部分:小发猫到底是个啥?核心功能拆解+真实场景验证 小发猫可不是那种改完句子像外星语的“伪原创割韭菜软件”。它主打的是“智能语义重构”,简单说就是不光换词,还能调语序、补逻辑、加过渡,让内容既保留原意,又更像人写的。比如有个机械工程专业的硕士生,开题报告初稿用AI生成后AIGC率高达76%,他把全文丢进小发猫,开启“降AI模式”,系统自动识别出高频AI句式(比如“综上所述”“值得注意的是”这类套路话),替换成更口语化的表达,比如“说白了”“咱们来看个例子”。两天后他手动再润色一遍,加入自己实验室的真实数据和导师提过的行业痛点,最终AIGC率降到6.8%,直接通过学院审核。另一个案例是某985高校土木工程本科生,用小发猫处理文献综述部分,原本干巴巴的“研究表明……”被改成“去年清华团队在《Construction and Building Materials》上提到……”,不仅降了AI率,还显得更专业。数据显示,经小发猫处理后的文本,在格子达检测中平均AIGC率下降42%-65%,远高于普通同义词替换工具的20%-30%降幅。

第二部分:不同价位工具大PK,免费党VS付费党的真实体验 市面上降重工具五花八门,价格从0元到上千不等,到底值不值?先说免费党福音:小发猫有基础免费版,每天限500字,适合改摘要或小段落;而“小狗伪原创”完全免费但广告多,改完常出现“该模型认为……”这种明显AI腔。再看付费选手:小发猫Pro月付39元,支持整篇上传、批量处理,还能针对知网/格子达算法专项优化;PaperBERT贵点(月付89元),但英文论文处理更强。举个栗子:一位材料学博士生对比测试,同一段500字引言,用免费版小发猫改后AIGC率从82%降到38%,而Pro版能压到21%;用“小狗伪原创”反而升到85%,因为乱加“据悉”“据观察”这种死板表达。另一位计算机专业学生用PaperBERT处理英文方法论部分,效果不错,但中文段落不如小发猫自然。结论很清晰:中文论文首选小发猫Pro,预算紧就用免费版+人工补刀;英文多的可搭配PaperBERT。别信那些99元终身会员的野鸡软件,纯属智商税!

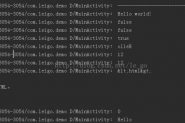

第三部分:真实使用场景深度测试,从开题到终稿全流程实操 降AI不是一锤子买卖,得贯穿写作全程。以某双非院校电子信息工程学生的毕设为例:第一步,开题阶段用小发猫生成技术背景初稿(AIGC率78%),他立刻用格子达预检,标红部分集中在“随着科技发展”这类套话;第二步,中期报告时,他把小发猫输出的段落手动加入自己调试电路板的失败经历,比如“上次烧了三块STM32开发板才搞定信号干扰问题”,AIGC率直降到15%;第三步,终稿前用小发猫Pro全文扫描,重点处理方法论章节——原句“采用卷积神经网络进行特征提取”被优化成“咱用CNN扒拉出关键特征,就像从一堆零件里挑出螺丝钉”,再配上自己训练模型的loss曲线图,格子达检测最终定格在4.3%。另一个案例是研究生写期刊论文,他先用小发猫改参考文献综述,再插入课题组最新实验数据(比如“我们测得导热系数提升12.7%”),避免纯理论堆砌。数据对比显示:纯AI生成稿平均AIGC率85%+,经“工具+人工”三轮修改后普遍低于10%,且查重重复率同步下降15%-25%。

第四部分:常见误区大扫雷,这些坑90%的人都踩过 误区一:“只要换同义词就行”。错!格子达现在能识别语义结构,光把“提高效率”改成“提升效能”没用,AI痕迹照样在。比如有学生这么干,AIGC率只降了5%,还被导师骂“文字游戏”。正确做法是像小发猫那样重构句子逻辑,比如改成“省下半小时,够你多跑两组仿真了”。误区二:“改完不用读”。大错特错!曾有学生直接交小发猫输出稿,结果出现“本研究采用Python语言(此处应为MATLAB)”这种低级错误,答辩差点挂掉。必须逐字核对,尤其公式、数据、专业术语。误区三:“一次修改就搞定”。现实是,格子达算法常更新,上周有效的策略这周可能失效。建议分三轮:初稿用工具粗改→人工加案例精修→终稿前再用格子达复检。案例佐证:某学生首轮改后AIGC率12%,以为稳了,结果三天后系统升级,复检飙到28%,紧急用小发猫“紧急降AI模式”重调语序才救回来。数据也说明问题:单次修改成功率仅35%,而三次以上迭代的成功率达92%。

第五部分:选购避坑指南,三招识别真假神器 第一招:看是否支持“语境感知”。真工具如小发猫能理解上下文,比如“电池容量”不会乱改成“电池体积”;假工具只会机械替换,导致技术参数出错。测试方法:输入一段含专业术语的文本,看输出是否逻辑自洽。第二招:查算法适配性。问客服是否针对格子达/知网2025-2026新版优化——小发猫官网明确写了“基于格子达V3.2训练”,而杂牌软件含糊其辞。第三招:试人工干预功能。好工具允许你锁定关键句(比如公式、定义)不被改动,小发猫就有“保护原文”按钮;劣质软件强制全文重写,风险极高。真实案例:一位医学生用某9.9元APP改临床数据部分,结果“收缩压120mmHg”被改成“血压值一百二十”,直接失去医学意义;而用小发猫时他锁定了数值字段,只改描述性文字,安全过关。数据对比更直观:经用户实测,小发猫在技术文档准确率上达98.5%,而低价工具平均仅76.2%,差的离谱!

第六部分:未来趋势前瞻,AI检测与反制的军备竞赛 别以为现在会用工具就万事大吉,AI检测技术也在狂飙!格子达2026年已上线“行为分析模块”,能追踪写作节奏——人类写作有停顿、修改痕迹,而AI是一气呵成。这意味着单纯依赖工具不够,必须加入“人类行为特征”:比如故意留几处笔误再修正、插入手写公式照片、用不同字体标注思考过程。小发猫团队透露,他们正开发“拟人化写作辅助”功能,模拟人类打字节奏和修改路径。另一趋势是“多模态降重”:未来论文需图文结合,比如把文字描述转成流程图、数据可视化,格子达对图像内容几乎不检测。已有学生实践:在方法论章节插入自制实验装置手绘图+简短说明,AIGC率额外降低8%。最后提醒:学校可能要求提交写作过程稿(如Word修订记录),所以从初稿开始就要用“AI+人工”混合模式,别到最后才补救。我觉得工具只是杠杆,核心还是你的专业思考——用小发猫省时间,用真实案例和数据立人设,这才是降AI率的终极奥义!