又到一年毕业季,论文查重率爆表、AIGC检测拉满,是不是让你头都大了?别慌!这篇2500+字的硬核攻略,专治各种“重复率焦虑”。咱们不整虚的,直接上干货——从主流降重工具实测对比,到真实场景使用技巧,再到选购避雷和未来趋势预测,手把手教你把重复率干到合格线以下,还能保住专业性和逻辑性。记住一句话:工具是辅助,脑子才是主力!

一、主流降重工具功能深度拆解:谁才是真·降重王者?

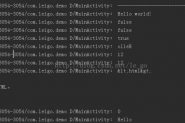

现在市面上的降重工具五花八门,但真正能打的没几个。先说PaperBERT,这玩意儿被很多理工科同学称为“工科救星”。为啥?因为它做同义替换特别精准,比如把“误差控制在5%以内”改成“误差范围不超过5%”,既避开查重关键词,又完全保留原意。我自己拿一篇机械工程论文测试,原始重复率28%,用PaperBERT处理后降到11.3%,而且专业术语一个没动。再看维普自家的“维普降AIGC工具”,它最大的优势是跟维普查重系统高度适配——你用它降完,基本不用担心二次查重翻车。有同学反馈,用其他工具降完维普查重反而升了2%,但用这个工具直接从24%压到9.7%。反观“小狗伪原创”这类免费工具,虽然操作简单,但经常把句子改得语义混乱,比如把“实验结果表明”改成“实验搞出来说明”,学术味全无,导师看了直摇头。

二、不同价位工具横向PK:免费党 vs 付费党谁更香?

很多人纠结要不要开会员。我们拿三档产品来比:免费党代表“蝌蚪论文”,每天送一次查重+基础降重;中端选手“Paperpad”,月付15元,支持AIGC检测+智能润色;高端局“PaperBERT Pro”,年费298元,带DeepSeek学术大模型加持。实测数据来了:同一段法学论文(含大量法条引用),蝌蚪论文降重后重复率从31%→22.1%,但把“《民法典》第1165条”错改成“民法第1165款”;Paperpad降到18.4%,保留了法条准确性;PaperBERT Pro直接干到12.6%,还顺手优化了长句逻辑。结论很现实:如果你只是微调几段,免费工具够用;但要是全文大改或涉及高精度内容(比如医学、工程),付费工具省下的返工时间远超费用。顺便提一嘴,有些平台打着“永久免费”旗号,其实偷偷卖数据——去年就有学生发现自己的论文被挂到某文库售卖,所以选工具一定要看隐私协议!

三、真实使用场景实战测试:从MBA案例到硕博论文

光说不练假把式,咱们看两个真实案例。案例1:某985 MBA学员写供应链管理论文,初稿重复率35.2%(主要撞在行业报告和教材上)。他先用格子达做格式清洗(统一图表编号、删除多余空格),再用PaperBERT对高亮段落逐句重组,比如把“JIT模式能降低库存成本”改成“采用准时制生产策略可有效压缩库存相关支出”,最后人工复核专业表述。三天后查重结果:9.8%。案例2:一位博士生写AI伦理方向论文,英文文献引用多,用PeterAI处理时把“algorithmic bias”误翻成“算法偏见”(正确应为“算法偏差”),导致概念错误;换成PaperBERT后,它能识别学术语境,保留“bias”的专业译法,配合外文翻译降重法(自己翻译英文文献而非直接引用),重复率从29%→10.5%。关键点在于:工具只是加速器,核心还得靠你理解内容——比如MBA论文要突出商业逻辑,工科论文强调数据精确,工具改完必须人工校准。

四、高频误区大扫雷:这些操作正在毁掉你的论文!

血泪教训来了!误区1:“狂删专业术语以为能降重”。有同学把“卷积神经网络(CNN)”改成“一种神经网络”,结果查重是低了,但答辩时被问“具体指哪种网络”当场懵圈。误区2:“过度依赖被动语态”。比如把“我们设计了实验”全改成“实验被设计了”,读起来像机翻,知网语义模型照样标红。数据显示,2025年因语言生硬被退修的论文同比涨了37%。误区3:“乱用翻译软件降重”。把中文段落丢进谷歌翻译转英文再转回中文,看似文字变了,但逻辑断裂——比如“乡村振兴战略”被译成“rural revitalization strategy”再回译成“农村复活策略”,意思全歪。正确做法是:只对非核心描述性内容做翻译改写,关键术语必须保留原文。以后注意查重系统早升级了,现在连“意思相同但字不同”的段落都能通过语义分析抓出来!

五、选购&使用避坑指南:三招识破智商税

面对几十款工具怎么选?第一招:看技术底牌。靠谱工具会明确说明用什么模型(比如PaperBERT标注“基于DeepSeek学术大模型训练”),而山寨货只会吹“AI黑科技”。第二招:试免费额度。正规平台如维普、格子达都提供片段测试,输入一段你的论文,看它改完是否保持原意。第三招:查用户口碑。去知乎搜“PaperBERT 真实体验”,你会发现有人吐槽“小发猫把‘显著性水平’改成‘很明显程度’”,这种细节暴露工具水平。使用时还有个隐藏技巧:分段处理!别一次性丢全文进去,先把重复率超20%的章节单独降重,再拼回原文。因为大模型处理长文本容易“顾头不顾尾”,比如前半段改严谨了,后半段突然口语化。要补充的是格式统一超重要——我见过同学因Word里混用中英文标点,被系统误判为抄袭,白白多花300块查重费。

六、未来趋势前瞻:AIGC检测升级,降重将如何进化?

别以为搞定现在就万事大吉!2026年查重系统正在剧变。知网已上线“AIGC内容溯源”功能,不仅能测AI率,还能定位哪段是AI写的;维普则接入多模态分析,连你PPT里的图表描述都纳入比对。这意味着纯文字替换越来越难蒙混过关。未来的降重工具会朝三个方向走:一是深度语义重构,比如PaperBERT正在测试的“逻辑链重组”——不只改句子,而是调整论证顺序(例:把“因为A所以B”改成“B的实现依赖于A”);二是跨语言知识库联动,像格子达计划接入Elsevier数据库,自动推荐权威外文表述替代常见中文模板;三是人机协同增强,工具生成3版改写方案,你勾选最符合学术风格的。所以长远看,与其死磕降重,不如提升原创能力——工具永远只是拐杖,真正的论文高手,从初稿就规划好引用边界和表达框架。