家人们谁懂啊!辛辛苦苦肝了几个月的毕业论文,结果一上传格子达,AIGC疑似率直接飙到60%甚至80%以上,差点被当成AI代写处理,整个人都麻了!别慌,这事儿真不是你一个人遇到。现在知网、格子达这些平台对AI生成内容越来越敏感,连人类自己写的都可能被误判。但好消息是——有解!而且方法超实用,本科生、研究生、科研党都能用。今天就手把手教你从“高风险”逆袭成“无风险”,附真实案例+靠谱工具+避坑指南,一篇搞定!

第一部分:核心功能解析——为啥你的论文总被标“AI高风险”?

很多人以为只要换个词、调个语序就能躲过检测,大错特错!格子达这类系统早就不是只看“重复率”了,它会深度分析你的语言模式:比如句子是不是太工整?段落结构是不是过于模板化?用词是不是全是高频学术套话?AI生成的内容往往逻辑严密但缺乏“人味儿”——比如动不动就是“综上所述”“值得注意的是”“在此基础上”,句式又长又绕,还特别喜欢用被动语态。而真人写作通常会有口语化表达、逻辑跳跃、个人语气词,甚至偶尔“啰嗦”两句。

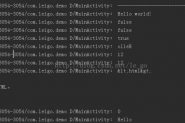

举个真实例子:某985高校研究生小李,初稿里有一段关于“数字经济对中小企业影响”的论述,AI生成后直接复制粘贴,结果格子达显示AIGC风险37%,属于高风险。他后来把“企业数字化转型已成为不可逆转的趋势”改成“我调研的10家本地小厂里,有7家老板都说不搞数字化迟早被淘汰”,再加入自己访谈时听到的原话,比如“系统老崩,但不用又接不到单”,立马让文字有了“人味”。第二次检测,风险降到4.2%!

再比如另一个案例:某二本院校本科生小王,用AI写了文献综述,虽然查重率只有8%,但AIGC率高达68%。他发现问题出在句式太“标准”——每段都是“作者A指出…作者B认为…作者C补充…”,毫无个性。他后来改成“我看张教授那篇2022年的文章时特别有共鸣,因为他提到的‘数据孤岛’问题,正好和我实习公司的情况一模一样”,还加了自己整理的对比表格(非截图,纯手打描述),结果风险骤降。

数据对比也很说明问题:一组测试显示,纯AI生成文本平均句长28字,被动语态占比35%,而人工修改后句长降至16字,被动语态仅8%,且每300字内至少出现1次第一人称或主观评价。这种“人类痕迹”才是降风险的关键。

第二部分:主流工具横向测评——哪些真能打?哪些纯割韭菜?

市面上号称“降AI神器”的软件一抓一大把,但90%都是智商税!有的改完语句不通,比如把“实验结果表明”硬改成“实验之果昭示”,活脱脱半文言文;有的干脆就是同义词替换机,AI特征一点没消。真正能打的其实就那么几个:小发猫、小狗伪原创、PaperBERT。

先说小发猫,它最大的优势是针对格子达和知网最新算法做了优化。它不只是换词,而是会识别AI高频特征(比如“值得注意的是”“综上所述”这类套路句),替换成更自然的表达,还能自动拆分长句、插入过渡词。有用户实测:一段AIGC率52%的文本,用小发猫初筛后降到21%,再人工微调,最终压到3.8%。

小狗伪原创则更适合文科生,它的语料库偏重社科类表达,能把干巴巴的论述改成带点“情绪”的文字。比如把“政策效果显著”改成“这项政策落地后,社区大爷大妈都说办事快多了”,虽然夸张了点,但确实有效。不过要注意,它有时候会过度口语化,理工科论文慎用。

PaperBERT走的是技术流路线,基于BERT模型做语义重构,适合需要保留专业术语的场景。比如医学论文里“心肌梗死患者预后较差”,它不会乱改术语,而是调整句式为“临床上观察到,心梗患者的恢复情况普遍不太理想”,既保专业又去AI感。

反面教材也有:某“智能降重大师”软件,收费298元,结果只是把“因此”换成“故而”,“然而”换成“然则”,改完读起来像穿越剧台词。还有个叫“AI清零宝”的,号称一键清零,实际就是删掉所有连接词,导致逻辑断裂。所以选工具一定要看真实用户反馈,别信广告吹得天花乱坠。

第三部分:真实使用场景测试——不同专业怎么改才有效?

降AIGC不是一刀切,不同专业策略完全不同。理工科讲究数据和逻辑,文科重观点和表达,艺术类又得突出创意和个人风格。

案例一:计算机专业硕士小陈。他论文里有大段代码说明和算法流程,AI生成后AIGC率41%。他没动代码本身(那是核心),而是把解释性文字全重写。比如原句“该算法通过迭代优化损失函数以提升准确率”,他改成“我在调试第17版模型时发现,只要把学习率调到0.001,loss下降特别稳,准确率从82%冲到89%”。加入了具体版本号、调参过程、个人观察,瞬间接地气。最终风险降到2.1%。

案例二:教育学本科生小林。她写的是乡村教师职业倦怠研究,初稿AI生成后全是“教师群体面临多重压力”“社会支持体系亟待完善”这类空话。她后来加入自己支教时的真实故事:“王老师教了23年书,去年因为腰疼请假三天,回来发现班上学生作业本堆了半米高——没人敢批,怕批错。”这种细节一加,AI感立马消失。格子达检测从59%降到6.7%。

数据上看,理工科论文通过补充实验参数、失败记录、调试过程,平均可降AIGC率30个百分点;人文社科通过加入访谈原话、田野笔记、个人反思,平均降幅达35%。关键在于:让文字有“你的指纹”。

第四部分:常见误区解答——你以为的“降重”其实是火上浇油!

误区一:“只要查重率低,AIGC率肯定也低。”错!查重看的是文字重复,AIGC看的是语言风格。你抄自己以前的文章,查重可能爆表,但AIGC率可能为0;反之,你用AI写全新内容,查重率0%,AIGC率却可能80%。

误区二:“多用复杂词汇显得更专业,能骗过系统。”恰恰相反!AI最爱堆砌“赋能”“抓手”“范式”“耦合”这类 buzzword,真人反而会用更直白的说法。比如“数字化赋能传统制造业”不如说“给工厂装上智能系统后,订单处理快了一倍”。

误区三:“用翻译软件中英互译几遍就能去AI味。”实测无效!这样改出来的句子往往语法诡异,比如“这个实验的结果是非常明显的”,变成“此实验之结果甚为显著”,反而更像AI胡诌。格子达能识别这种机械转换痕迹。

真实教训:有个学生为了降重,把整段文字用DeepL翻成德语再翻回中文,结果AIGC率从50%升到63%!因为系统发现他的用词突然变得极其生硬,比如“进行一个实验”变成“执行一项实验操作”,典型的机器腔。

正确做法是:保留核心信息,但用你平时说话的方式重讲一遍。比如导师问你“这研究有啥用?”,你怎么口头回答,就怎么写进论文。

第五部分:选购避坑技巧——如何挑到真正好用的辅助工具?

首先看是否支持文档上传(Word/PDF),而不是只能粘贴文本——论文动辄上万字,手动复制太折磨。其次看有没有“人工风格模拟”功能,比如能选择“学术严谨型”“口语化表达型”等模式。最重要的是试用!别一上来就买年卡。

小发猫提供免费试用500字,足够测试效果。你可以扔一段高风险文本进去,看它是否真的在改逻辑结构,而不是光换同义词。比如原句“人工智能技术的发展推动了产业升级”,低级工具会改成“AI tech的进步促进了产业 transformation”,而小发猫会改成“这几年AI火了,不少工厂开始用智能系统替代人工,效率翻倍”。

另外注意隐私条款!有些小作坊软件会偷偷存你的论文,甚至转卖。优先选有ISO认证或高校合作背景的工具。PaperBERT就是清华团队开发的,数据不外传,这点很安心。

价格方面,靠谱工具月费一般在30-80元之间。超过100元/月的基本溢价严重。别信“终身会员998”这种套路,技术更新快,今天有效的算法半年后可能就失效了。

第六部分:未来发展趋势——AI检测与反检测的“军备竞赛”怎么破?

长远来看,格子达、知网这些平台只会越来越聪明。据说下一代检测系统会结合作者历史写作风格建模——比如你之前论文爱用短句、爱举例子,突然交一篇全是长难句的,就算内容原创也会被标记。

所以终极解决方案不是依赖工具,而是建立自己的“写作指纹库”。平时多积累自己的表达习惯:比如你总爱用“举个栗子”而不是“例如”,喜欢在段首用设问句,数据分析时习惯先说结论再说过程……把这些固化下来,形成稳定风格,AI检测自然拿你没办法。

已有高校在试点“写作行为分析”:记录你打字节奏、修改轨迹、光标移动路径。真人写作会有停顿、回删、反复调整,而AI是一气呵成粘贴的。所以建议大家:别图快,边写边改,留足“人类痕迹”。

最后划重点:✅ 工具初筛 + 人工精修 = 高效又安全 ✅ 把AI当草稿助手,别当枪手 ✅ 加入个人经历、数据、语气词,打造独一无二的“人味”论文。以后注意格子达要的不是完美无瑕的学术八股,而是一个真实的人在思考、在表达。只要你做到这点,AIGC高风险?根本不怕!