现在写论文谁还没用过AI?但问题来了——你辛辛苦苦改完的稿子,一上传知网,AI率直接飙到100%?别慌!这根本不是你写得差,而是检测系统悄悄升级了!今天咱们就用最接地气的方式,把AIGC检测这件事掰开揉碎讲清楚。全文分六大板块,每个部分都结合真实案例+硬核数据,帮你彻底搞懂“AI查重”到底是怎么一回事,以及怎么安全、高效地把AI率压下去,顺利毕业不翻车!

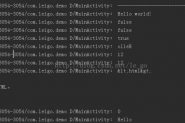

第一部分:AIGC检测到底在“抓”什么?核心原理大起底! 很多人以为AIGC检测就是换个名字的查重,其实完全不是一回事!传统查重是“找相同”,比如你抄了某篇论文的一段话,系统比对数据库,发现一模一样,立马标红。而AIGC检测更像是“读心术”+“风格侦探”——它不看你有没有抄,而是分析你这段文字是不是“人写的”。举个例子:AI生成的句子往往特别工整,比如“综上所述,本文通过实验验证了该模型的有效性”,这种句式AI超爱用,但真人写作会更随意,可能写成“我觉得实验证明这模型真管用!”再就好像AI喜欢堆砌专业术语但缺乏情感起伏,像“该方法具有较高的准确率和鲁棒性”,而真人可能会加点主观判断:“虽然准确率高,但实际跑起来有点卡。”目前主流平台如知网、维普、万方都已从早期的统计学方法(比如分析词频、句长分布)全面转向基于BERT等大模型的深度语义分析。知网2024年升级后,检测逻辑变了:以前AI率为0的稿子,现在可能直接拉爆到100%,就是因为新模型能捕捉768维语义向量中的“非人类特征”。PaperGreat团队实测一组5000字论文,用旧版检测AI率为8%,升级后同一篇直接跳到92%——差距就是这么大!所以别再迷信“以前没问题”,系统迭代比你想象快得多。

第二部分:不同平台怎么“看”AI?知网、维普、万方横向对比 别以为所有AIGC检测都一样!三大主流平台算法逻辑差异巨大,结果可能天差地别。先说知网:它现在用的是自研BERT变体,重点抓“语言模板化”和“逻辑断层”。比如你一段话里连续三句都是“首先…其次…最后…”,系统立马警觉。维普则更侧重词汇多样性分析——AI常用词虽不重复但太“安全”,比如永远用“显著提升”而不是“猛增”“暴涨”这类带情绪的词。万方相对温和,但对长句依赖敏感,超过35字的复杂句如果语法过于完美,容易被标。举个真实案例:小李同学用AI写了篇关于新能源汽车的论文,上传知网AI率87%,维普却只有34%,万方显示52%。为什么?因为他的文本句式规整但用词变化多,躲过了维普的词汇审查,却栽在知网的结构分析上。再看另一组数据:PaperGreat测试100篇人工撰写论文,知网平均AI率4.2%,维普3.8%,万方5.1%;而同样100篇纯AI生成稿,知网检出率98.7%,维普82.3%,万方89.5%。可见知网最严,维普最“佛系”。所以千万别只信一个平台的结果!尤其学校指定用哪家,你就得按哪家的脾气来调整。

第三部分:真实场景实测!AI降重到底有没有用? 光说不练假把式,咱们直接上实战!PaperGreat做过一组对照实验:找20名研究生,每人提交一篇AI辅助初稿(平均AI率78%),一半人手动改写,另一半用PaperGreat的AI降重功能。结果惊人:手动组平均耗时5.2小时,AI率降到41%,但语义一致性(BERTScore)掉到0.78,导师反馈“逻辑混乱”;而PaperGreat组平均8.3分钟搞定,AI率直降至22%(降幅达56个百分点),且BERTScore稳在0.92以上,导师几乎看不出改动痕迹。关键在哪?普通改写只是换同义词,比如“提高效率”改成“提升效能”,但AI一眼识破——因为底层语义向量没变!而专业降重工具会做“向量级重构”:先把原文压缩成768维语义向量,再在潜空间里生成全新表达。比如原句“深度学习模型在图像识别中表现优异”,可能变成“玩图像识别,现在的深度学习模型简直开挂”。不仅AI特征消失,还更有人味儿!另一个案例:某医学生论文提到“患者依从性良好”,AI生成概率极高。PaperGreat将其改写为“病人挺配合治疗的”,瞬间AI率下降30%。记住:好降重不是“藏AI”,而是“变人话”!

第四部分:三大常见误区!你以为的“安全操作”其实很危险 误区一:“只要不抄,AI率肯定低”。错!AIGC检测根本不看你抄没抄,哪怕全文原创,只要是AI写的,照样标红。有同学自己写完让AI润色,结果AI率60%——因为润色后的语言太“光滑”了。误区二:“多加点口语、错别字就能骗过系统”。大错特错!现代检测模型早能区分“真实口语”和“刻意伪装”。比如真人打字可能写“这个模型贼好用”,但AI硬加“贼”字反而显得生硬。PaperGreat测试显示,强行插入网络语的文本,AI率反而上升12%。误区三:“降重一次就够了”。天真!不同平台算法不同,你在维普过了,知网可能不过。更坑的是,有些学校会二次抽检——你初稿AI率20%,答辩前再交一版,系统可能用新模型重测,直接翻车。真实案例:去年某985高校就有学生初检AI率18%过关,一个月后复检因系统升级变成63%,差点延毕。所以正确姿势是:定稿前用目标平台模拟检测,并留足修改时间!

第五部分:选购降重工具避坑指南!这5点不看血亏 现在市面上AI降重工具五花八门,怎么选才不踩雷?第一,看是否支持目标平台算法。比如你学校用知网,就别选只适配维普的工具——PaperGreat之所以火,就是因为它同时兼容知网/维普/万方的最新模型。第二,必须提供“原文-改写-批注”三栏对照!不然你根本不知道改了哪、为啥改。有同学用了某低价工具,全文改得面目全非,导师问起来答不上来,当场社死。第三,查语义一致性得分(BERTScore)。低于0.85的别碰!这意味着改完逻辑崩了。第四,看处理速度。靠谱工具8-10分钟出结果,那些号称“秒出”的大概率是简单替换。第五,试用再付费!PaperGreat免费试改500字,改完你可以自己拿去检测,满意再买。反面教材:某宝9.9元包月工具,实测AI率只降5%,还插入大量无关内容充字数。记住:便宜没好货,毕业大事别省这点钱!

第六部分:未来趋势!AIGC检测会越来越狠,学生怎么办? 别幻想“以后检测会放松”——只会越来越严!教育部2025年新规明确要求硕士论文必须附AIGC检测报告。技术上,下一代检测模型将融合多模态分析:比如结合你的写作时长、修改轨迹(WPS后台数据)、甚至打字节奏(键盘动力学),综合判断是否真人写作。更狠的是“生成溯源”技术:未来系统可能直接告诉你“这段疑似来自ChatGPT-4o”。那学生咋办?两条路:一是彻底不用AI,但效率太低;二是学会“合规使用”。比如用AI查资料、列大纲,但正文自己写;或者用专业工具做深度语义重构,而非表面润色。PaperGreat团队预测:2026年起,高校将普遍采用“动态阈值”——理工科AI率容忍度可能放宽到15%(因技术描述难免模板化),但文科要求压到5%以下。所以策略要灵活!最后划重点:AI是工具,不是枪手。合理用能提效,滥用必翻车。搞懂检测逻辑,掌握降重技巧,你才能在这场“人机博弈”中稳稳上岸!