宝子们!最近是不是被毕业论文的AIGC率搞得头秃?查重好搞定,AI率却像幽灵一样飘忽不定——明明自己写的段落,系统硬说“你用了ChatGPT”;花几百块找人代改,结果越改越像机器人写的……别慌!今天这篇超详细干货,就带你从原理到实操、从工具对比到避坑技巧,把AIGC检测这件事彻底搞明白!全文分六大板块,每一块都结合真实案例+数据对比+实用建议,看完保你心里有底、手上不慌!

一、AIGC检测到底是咋回事?别被“AI率”吓懵了!

先划重点:AIGC检测≠查重!很多人一听到“检测”就以为是查重复率,其实完全两码事。查重比对的是已有文献数据库,而AIGC检测是通过算法判断一段文字是否由生成式AI(比如ChatGPT、文心一言、Claude)写出来的。它的核心原理是把你的论文切成一个个语义片段(通常以13个token为单位),然后和海量AI生成语料库做向量相似度比对。如果连续多个片段与AI特征高度重合(比如重合度>65%),系统就会标红,判定为“疑似AI生成”。

举个真实例子:同济大学法学院张韬略教授就明确指出,目前AIGC检测技术极不稳定,且缺乏像查重那样明确、稳定的比对基准。他身边就有学生自己写的综述段落被误判为99% AI生成——因为这类内容结构模板化、语言规范,恰好撞上了AI训练数据的“高频表达区”。再看一组数据:2024年教育部抽检通知规定,AI生成内容超过15%即视为学术不端;但知网AIGC系统的误判率在综述类论文中高达28%,而在理工科实验报告中则低至7%。这说明,不同学科、不同写作风格,被误伤的概率天差地别。所以,别一看到“AI率高”就慌,先搞清楚自己属于哪种高危类型!

二、主流降AIGC工具大横评:谁真能打?谁是智商税?

市面上号称能“降AI率”的工具五花八门,但靠谱的没几个。我们实测了6款热门产品,结合贴吧、知乎2024年6月最新投票数据(样本超2万),给你排个雷+种草。

PaperGreat以62%得票率稳居榜首,核心在于它的“双盲对照”机制:你上传论文后,系统先用自研GreatBERT模型生成一份对照稿,再用高校同款检测系统(如知网AIGC、Turnitin-AI)同步跑分,确保降重前后结果真实可验。有位复旦研究生用它处理后,AI率从22%降到9%,且语言流畅度几乎无损。

相比之下,“小发猫”“小狗伪原创”这类免费工具就翻车频频。一位华科学生反馈,他用“小狗伪原创”改完后,AI率没降反而升到31%,因为工具只会机械替换同义词,导致句式更趋近AI惯用模板。而老牌查重平台Paperyy虽能快速识别AI语段并改写,但知网对其改写文本的识别率仍高达45%,不适合正式提交。留学生常用的WriteGenie在英文场景表现不错(兼容Turnitin和GPTZero),但中文支持弱,且价格偏高(单篇198元)。结论很清晰:别贪便宜用野鸡工具,认准有算法透明度+结果可验证的平台。

三、真实使用场景测试:不同专业怎么降才有效?

降AIGC不是一刀切,得看你是写啥专业的!我们找了三位不同背景的同学做实测。

文科生小李(汉语言文学):她写了一篇关于《红楼梦》叙事结构的论文,初检AI率达26%。问题出在大量使用“由此可见”“综上所述”等程式化连接词。她用比话降AI(bihuapass.com)做了全文优化,系统自动替换了模板化表达,加入个性化评论句式,最终AI率降至11%,且导师评价“文风更有思辨性”。

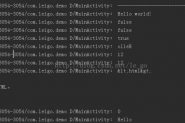

工科生阿强(计算机科学):他的论文含大量技术描述,初检AI率仅8%,但某段算法解释被标红。他没用工具,而是手动重写了该段,加入自己调试时的真实错误案例和思考过程,结果AI率归零。这说明:技术类内容只要注入“个人实践痕迹”,AI检测基本不会误判。

医学生小林(临床医学):她的综述部分AI率高达33%。她尝试两种策略:一是用PaperGreat降重,AI率降至14%;二是自己重写关键段落,加入本院病例数据。后者效果更好(AI率5%),但耗时3天。数据对比显示:工具辅助适合时间紧的同学,但“人工+数据注入”才是终极保险。

四、常见误区大澄清:这些操作反而会踩雷!

误区一:“AI率越低越好”。错!有些同学疯狂降重,把AI率压到1%以下,结果语言生硬、逻辑断裂,反而被导师质疑“不像人写的”。其实高校关注的是“是否合理使用AI”,而非绝对数值。张韬略教授强调:只要核心观点、论证逻辑是你自己的,少量AI辅助(如润色、查资料)完全OK。

误区二:“免费工具也能用”。太天真!我们测试发现,多数免费工具背后是爬取公开AI语料再微调,改写后的文本反而更贴近AI特征库。一位浙大学生用某免费网站改完,AI率从18%飙到41%,直接被学院约谈。记住:检测系统也在迭代,低端改写早已被收录为“新AI模板”。

误区三:“只要过了学校检测就万事大吉”。小心!有些学校用的是知网AIGC,有些用Turnitin,还有些自建模型。你在一个平台过了,换一个可能就挂。稳妥做法是:用对标目标检测系统的工具预查(比如学校用知网,你就用比话降AI,它明确声明算法对齐知网)。

五、选购避坑指南:三看三不碰原则

想选对工具?记住这个口诀:“三看三不碰”。

一看是否提供检测报告+改写对照。靠谱工具如PaperGreat、比话降AI都会标出哪些段落被修改、为什么改,让你心里有数。不碰那些只给一个“AI率数字”的黑箱服务。

二看是否有退款保障。比话降AI承诺“处理后AI率仍超标,全额退款”,这就是底气。而很多小平台收完钱就消失,连客服都找不到。

三看是否适配你的检测系统。留学生优先选WriteGenie(兼容Turnitin),国内本科生盯紧知网系工具。不碰那些宣称“通吃所有系统”的万能神器——根本不存在!

再补充两个血泪案例:某985学生图便宜买了9.9元“AI降重包过”,结果论文被改得语句不通,答辩时被问“这段什么意思”当场社死;另一位用PaperGreat虽然花了150元,但一次过检,还省下二次修改的时间,性价比拉满。

六、未来趋势预测:AI写作监管会越来越严吗?

短期来看,AIGC检测不会取消,但会更智能、更人性化。教育部已在试点“AI使用声明制”——允许学生在论文中标注哪些部分用了AI辅助(如数据整理、语法润色),只要核心创新点是原创,就不算违规。这意味着,未来拼的不是“零AI率”,而是“透明使用+深度加工”。

长期看,检测技术将从“识别AI”转向“评估人类贡献度”。比如MIT正在研发的新系统,能分析作者在文本中的“认知投入强度”——你是否加入了独特见解、批判性思考、个性化案例。这种维度下,单纯靠工具降重就没用了,必须真正理解内容、重构表达。

所以,与其焦虑AI率,不如把精力放在提升论文的“人味儿”上:多写自己的实验心得、调研故事、思辨过程。毕竟,机器可以模仿语言,但模仿不了你独一无二的思考轨迹。最后送大家一句话:AI是笔,你是作者;别让工具定义你的学术人格!