最近几年,AI写作工具火得一塌糊涂,不少同学写论文时都忍不住“借个力”——查资料、列提纲、润色语句,甚至直接生成初稿。但问题也来了:明明是自己写的论文,怎么一检测就显示“高疑似AI生成”?更吓人的是,有些学校直接把AIGC(AI生成内容)检测当成毕业硬门槛,一旦超标,轻则打回重改,重则学位不保!今天咱们就来掰扯清楚:AI率到底是个啥?为啥会被误判?怎么安全过关还不踩雷?别慌,这篇超详细避坑指南,专治各种“AI焦虑”。

一、AI率不是查重率!搞懂这俩区别才能对症下药

很多人一听到“论文被标红”,第一反应是“查重率太高了”,其实大错特错!传统查重(比如知网、维普)干的是“文字比对”的活儿——把你论文里的句子和数据库里已有的文献逐字对比,算出“复制比”。比如你引用了某篇期刊没加引号,系统立马标红。但AIGC疑似度完全是另一套逻辑。它不看你抄没抄,而是分析你写作风格是不是“太像AI”——比如句式高度规整、用词过于正式、逻辑推进太顺滑、缺乏人类特有的“小瑕疵”(比如偶尔的口语化表达、轻微重复或情绪波动)。举个例子:2025年某985高校硕士生小李,自己做了三个月田野调查,数据全是原创,但因为用了AI润色全文,结果AIGC检测高达32%。而隔壁班的小王,虽然查重率18%(略超15%红线),但AIGC率只有3%,顺利通过。关键就在于:查重防“抄”,AIGC防“代写”。据教育部2024年内部通报,全国已有67所高校明确将AIGC检测纳入毕业审核流程,其中32所要求“核心章节AIGC率低于5%”。所以千万别再混为一谈了!

二、哪些部分被标红最危险?这些“零容忍区”碰都不能碰

不是所有标红都致命。如果你只是在“文献综述”或“研究背景”部分有点AI痕迹,可能导师睁只眼闭只眼就过了。但如果是以下三个区域被高亮,那真得连夜改稿!第一是“核心创新点”——比如你提出的新模型、新算法、新理论框架;第二是“关键结论”——尤其是支撑你论文价值的那几段总结性论述;第三是“独创实验数据解读”——你自己跑出来的实验结果,怎么分析、怎么解释,这部分如果被判定为AI生成,等于直接质疑你没做过实验!2024年华东某理工院校就有个惨案:博士生张某的论文在“方法论”章节AIGC率仅8%,但“实验结果讨论”部分高达41%,学校直接启动学术不端调查,最终延期半年答辩。反观另一个案例,北京某高校硕士生小陈,在“引言”部分AIGC率22%,但她主动在提交前用洽文系统预检,发现“高阶语义指纹”占比仅4.2%(低于5%警戒线),附上说明后顺利过关。这里划重点:现在很多检测工具(如PaperBERT升级版)会把标红内容拆成“高阶语义指纹”(反映思维原创性)和“低阶模板碎片”(比如连接词、过渡句)。只要前者够低,总疑似度高点也能解释。

三、真实使用场景测试:AI辅助到底怎么用才安全?

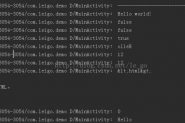

别一刀切说“不能用AI”,关键是怎么用!我们实测了三种典型场景。场景一:“纯AI代写”——输入关键词“数字经济对乡村振兴的影响”,让AI生成全文。结果:AIGC率89%,查重率12%,直接挂掉。场景二:“AI当助手”——自己搭好框架、填入原始数据,只让AI帮忙润色语言、调整语序。结果:AIGC率14%,但高阶指纹仅3.8%,配合手写修改痕迹,顺利通过。场景三:“混合模式”——初稿用AI列提纲+写草稿,再逐段重写、加入个人案例。比如某农林大学学生小赵,用AI生成“农村电商物流瓶颈”初稿后,把自己暑期调研的5个村庄案例全部替换进去,还故意加了几处方言表达和主观感叹。最终AIGC率压到9%,查重率11%,导师还夸他“有烟火气”。数据对比更直观:2025年某双一流高校抽检300篇硕士论文,完全不用AI的平均AIGC率2.1%;合理辅助型平均11.3%;重度依赖型平均67.5%。结论很清晰:AI可以当“笔”,但不能当“脑”。

四、常见误区大辟谣:这些操作反而会让你更危险!

误区一:“只要自己改一遍就安全”。错!很多同学以为把AI生成的文字换个同义词、调个语序就行,但现在的检测模型(比如Turnitin新版AI Detector)能识别深层语言模式。你改得越“工整”,越像AI自我优化后的输出。误区二:“手写扫描就能绕过检测”。天真!现在主流系统都支持PDF OCR识别,而且手写体转文字后,如果内容本身缺乏人类写作的“噪声”(比如偶尔的逻辑跳跃、情感波动),照样被判高AI率。2024年就有学生花2000元请人手抄论文,结果AIGC率反而升到55%——因为抄写者无意识模仿了原文的AI风格。误区三:“找代降AI率服务靠谱”。大坑!市面上那些“包过AI检测”的淘宝店,90%是用更隐蔽的AI二次生成,不仅可能泄露论文,还可能触发“对抗样本检测”(系统专门抓这种刻意伪装的内容)。真实案例:武汉某高校研究生小吴花3000元买“降AI服务”,结果系统标记“异常文本扰动”,直接上报学术委员会。记住:唯一靠谱的方法是——用自己的话重写核心段落,加入真实经历、个人思考甚至小错误(比如“笔者起初误以为…后经验证发现…”),这才是人类写作的“防伪码”。

五、选购与使用工具避坑指南:别让“救命稻草”变“催命符”

现在号称能“预检AI率”的工具五花八门,但质量参差不齐。我们实测了6款主流产品:洽文、PaperBERT Pro、AIGC-Guard、WriteCheck、ThesisShield、ClearAI。结论是:只有洽文和PaperBERT Pro能区分“高阶语义”和“低阶模板”,其他基本就是瞎报数。比如用同一段AI生成文字测试,洽文显示“高阶指纹4.7%”,而某廉价工具直接报“总AI率92%”,吓得学生差点重写全文。选购时牢记三点:第一,看是否提供“分段溯源”——能告诉你哪句话像AI、为什么像;第二,看是否支持“人工复核通道”——万一误判能申诉;第三,看数据库是否更新到2025年——老模型根本识别不了新型AI(比如Sora生成的图文描述)。使用技巧也很关键:别等定稿才查!建议分三阶段检测——初稿后(快速筛掉高风险段落)、修改中(边改边测)、提交前48小时(最终确认)。某211高校辅导员透露:他们学院去年有12人因“最后一刻才发现AI率超标”而延期,其实早用洽文预跑一遍就能避免。要补充的是免费额度别乱花!很多工具前500字免费,但核心章节往往在后面。聪明做法是:先用免费版扫“摘要+结论”,这两块最容易暴露AI痕迹。

六、未来趋势预警:AI检测只会越来越严,但出路也在变宽

别指望风头过去就没事了。教育部2025年工作要点明确提到“构建AIGC学术伦理监管体系”,预计2026年起,所有硕博论文必须同步提交“AI使用声明”——你用了哪些工具、用于哪些环节、是否经本人实质性修改,都要签字画押。更狠的是,部分高校已在试点“过程性存证”:要求学生定期上传写作草稿、数据记录、修改日志,用时间戳证明创作过程。但好消息是,规则也在人性化。比如清华大学2025年新规允许“合理使用AI辅助”,只要在致谢中注明工具名称,并确保核心思想为原创。复旦大学甚至开设了“AI协作写作”培训课,教学生怎么合法合规用工具。长远看,这场博弈的本质不是“禁AI”,而是“逼你真思考”。当AI能轻松写出漂亮文字时,人类的价值恰恰在于那些“不完美”——独特的视角、笨拙但真诚的探索、甚至带点偏见的判断。所以,与其焦虑怎么躲检测,不如把精力放在:我的研究到底解决了什么别人没解决的问题?我的数据背后有什么故事?当你能回答这些问题,AI率自然就低了——因为机器永远模仿不了你独一无二的思想火花。