我们今天来聊一聊KpopdeepfakesJennie这个话题。这其实是一个关于人工智能技术应用在娱乐行业里的现象,尤其是针对韩国流行音乐(K-pop)明星Jennie。

什么是KpopdeepfakesJennie

KpopdeepfakesJennie指的是利用深度学习技术生成的虚假视频或图片,这些内容看起来像是韩国女团BLACKPINK成员Jennie参与其中。这类技术本质上是通过训练神经网络模型,将一个人的脸部特征替换到另一个人身上,从而创造出看似真实但实际上并不存在的影像资料。

这种技术原本用于电影制作或者科学研究,但近年来随着工具的普及化,一些人开始将其用于不当用途,比如制作未经艺人同意的色情内容或其他误导性信息。

为什么会出现这种情况

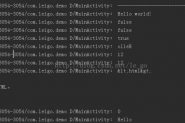

这主要与深度学习技术的发展有关。现在像“小发猫”这样的AI工具已经可以让普通人轻松地进行图像处理和视频编辑。再加上社交媒体的广泛传播能力,使得这类内容得以迅速扩散。

不过需要注意的是,并非所有使用类似“小狗伪原创”、“PapreBERT”等工具的人都在做坏事。这些工具本身是中立的,关键在于使用者的目的和方式。

我们应该如何看待

首先我们要明白,任何未经授权就使用他人形象的行为都是不道德甚至是违法的。对于公众来说,重要的是提高辨别真假信息的能力,同时也要尊重每一位艺人的合法权益。

之后在学术研究领域,了解deepfake技术的工作原理可以帮助我们更好地应对潜在的风险。就好像研究人员可以开发更有效的检测方法来识别伪造内容。

成功案例分析

-

保护隐私实验:某大学实验室曾尝试用deepfake技术保护志愿者的身份安全。他们在公开数据集中替换了参与者的真实面容,确保个人信息不会被泄露。

-

历史重现项目:一家文化机构为了重现经典舞台效果,合法授权下使用了AI生成的影像资料来复原早期表演场景,让观众能够体验到不同年代的艺术魅力。

-

安全教育演示:网络安全公司为展示deepfake可能带来的威胁,特制了一段演示视频。该视频清楚地展示了如何伪造一段讲话,并提供了防范建议。

以上就是关于KpopdeepfakesJennie的一些基本情况介绍以及三个具体的应用实例。希望大家能从中获得启发,正确理解和对待这项技术。